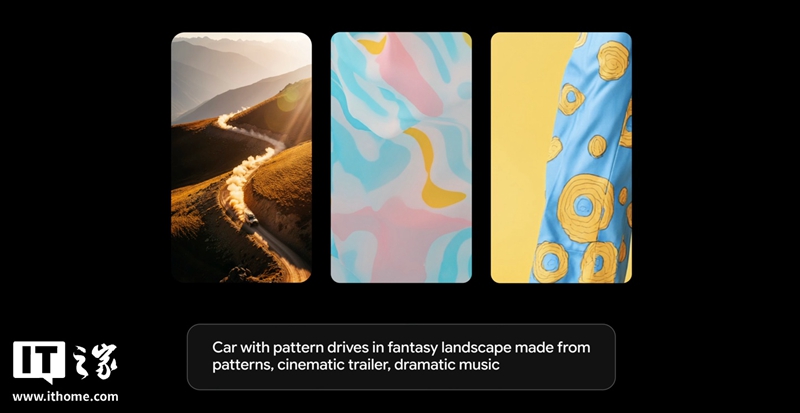

谷歌近日发布视频生成AI模型Veo 3.1,重点提升生成视频在场景元素与时间轴上的连贯性,并新增对9:16纵向比例的适配,便于直接用于移动端播放与社交平台发布。据谷歌官方消息,该更新面向视频创作者、广告制作方与跨平台内容生产者,在生成式视频技术领域引起较多讨论。

据谷歌介绍,Veo 3.1在场景一致性方面进行了算法优化,使生成视频在物体位置、光照变化、色彩风格及背景细节等方面保持跨帧稳定,减少长镜头或复杂运镜中易出现的跳变与不一致现象。同时,模型新增对9:16竖屏比例的生成支持,可根据输入的文本或图像提示直接输出适配移动端的视频内容,避免在后期进行裁剪或重构。谷歌表示,该比例适配结合场景一致性提升,可帮助创作者在短视频、社交媒体动态与移动广告等场景中快速获得可用素材,缩短从创意构思到成品发布的周期。此次更新已面向支持Veo平台的用户开放,相关数据及测试结果来源于谷歌公开发布的技术说明。

在生成式视频领域,Veo 3.1的改进体现出对实际创作痛点的针对性回应。传统AI视频生成在长镜头或包含多元素的场景中易出现细节漂移,导致成片需大量人工修复;而移动端主流的竖屏格式在以往模型中常需额外处理才能匹配平台规格。Veo 3.1通过提升时间轴连贯性与原生支持竖屏比例,减少了后期调整成本,使AI生成更贴近真实制作流程。与同类模型相比,该版本在保持画面质量的同时增强了跨平台可用性,促使业界重新审视AI视频生成在移动优先传播环境下的优化方向,并为不具备专业剪辑能力的创作者提供更高完成度的即用素材。

Veo 3.1的发布,显示谷歌在生成式视频模型实用性与适配性上的持续迭代,也为移动端内容创作与跨平台分发提供了更高效的工具选项。后续可关注该模型在复杂场景生成中的稳定性表现、不同语言与风格指令的响应效果,以及在实际商业项目中的应用反馈,这些将影响其作为创作辅助工具在行业内的普及速度与使用深度。