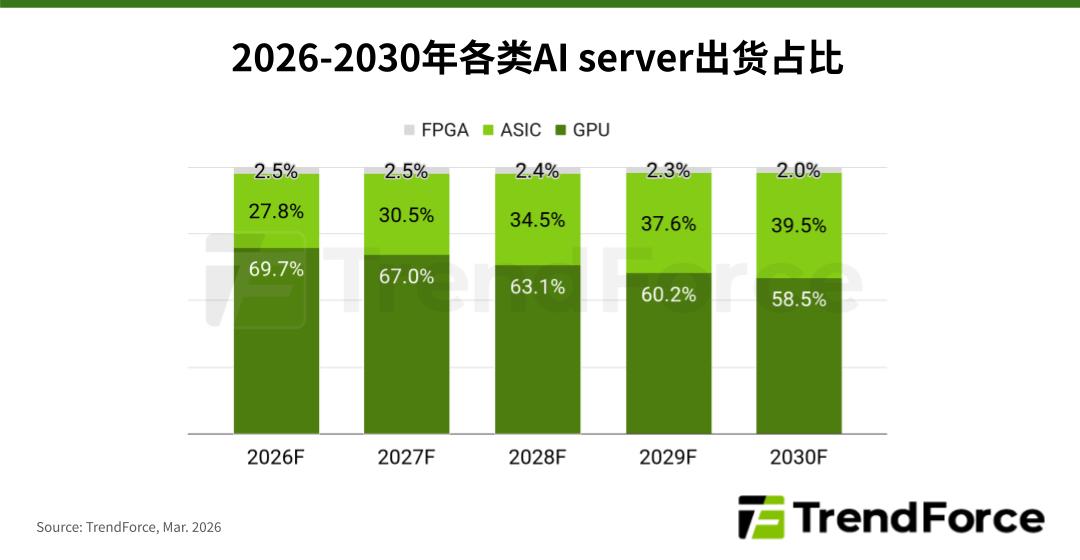

市场研究机构TrendForce预测,至2030年专用集成电路ASIC将占据AI服务器整体出货量近四成,较目前份额显著提升。ASIC因针对特定模型结构优化电路与数据流,可在推理与部分训练任务中实现更高能效比与更低时延,适配大模型部署与边缘推理场景。其崛起源于对GPU通用算力在特定任务中利用率不足的补充需求。

预测反映出AI算力需求多样化推动芯片架构分化,云服务商与硬件厂商加速布局定制化ASIC以降低成本与能耗。行业来看,此趋势将促使AI服务器供应链重构,从以GPU为主导转向GPU、ASIC与FPGA并存的多架构协同,提升整体算力利用效率。

2030年的ASIC占比预示AI基础设施将进入精细匹配阶段,未来芯片设计更重与应用场景紧耦合,通过软硬件协同优化实现性能与成本的双优解,为大规模模型商业化落地提供高效底层支撑。