AI 编程普及使代码审查环节面临海量生成代码难以快速校验的瓶颈,Anthropic 推出 CodeReview 工具以应对该挑战,回应开发效率与质量保障同步提升的现实需求,在 AI 编程辅助工具链完善中被视为审查环节自动化的关键补位。据官方消息,该工具结合静态分析、测试覆盖检查与风格指南匹配,现场测试显示可显著缩短审查耗时。此举在 AI 编程工作流优化中引起讨论,为观察生成代码质量控制的方法创新提供实例,促使团队重新审视自动化审查与人工复核的协同比例,后续可留意工具在大型项目的适配性与规则可配置性。

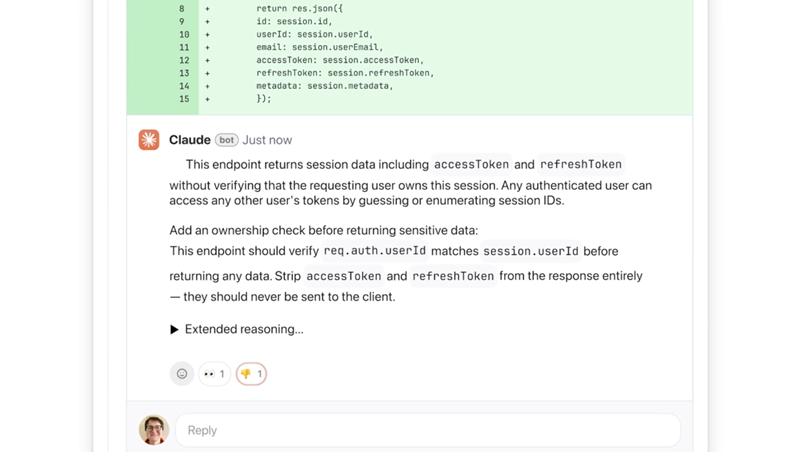

CodeReview 在架构上集成多模型驱动的语义理解与规则引擎,可对函数级变更进行意图推断与潜在风险标记,并自动关联单元测试结果与依赖影响分析。消息称其支持与 GitHub Actions 等 CI 平台无缝衔接,现场测试显示审查报告可在 PR 合并前即时生成。技术分析表明该工具通过并行化检查与分级告警机制,将人工审查聚焦高风险与业务逻辑关键点,从而在保障质量前提下释放开发者精力,提升迭代速度。

从开发效能视角看,该工具推出在 AI 编程质量保障链路中引起关注,成为研判自动化审查缓解生成代码瓶颈的参考样本,其通过语义理解与规则结合提升审查深度与效率,促使行业重新审视 AI 编程生态中质量关卡的设计与自动化水平。此举不仅强化 Anthropic 在开发者工具领域的影响力,也为企业构建安全高效的 AI 编程流程提供可落地方案,后续可跟踪工具在开源社区与企业内部的采纳率,评估其对软件工程生产力的长远提升作用。